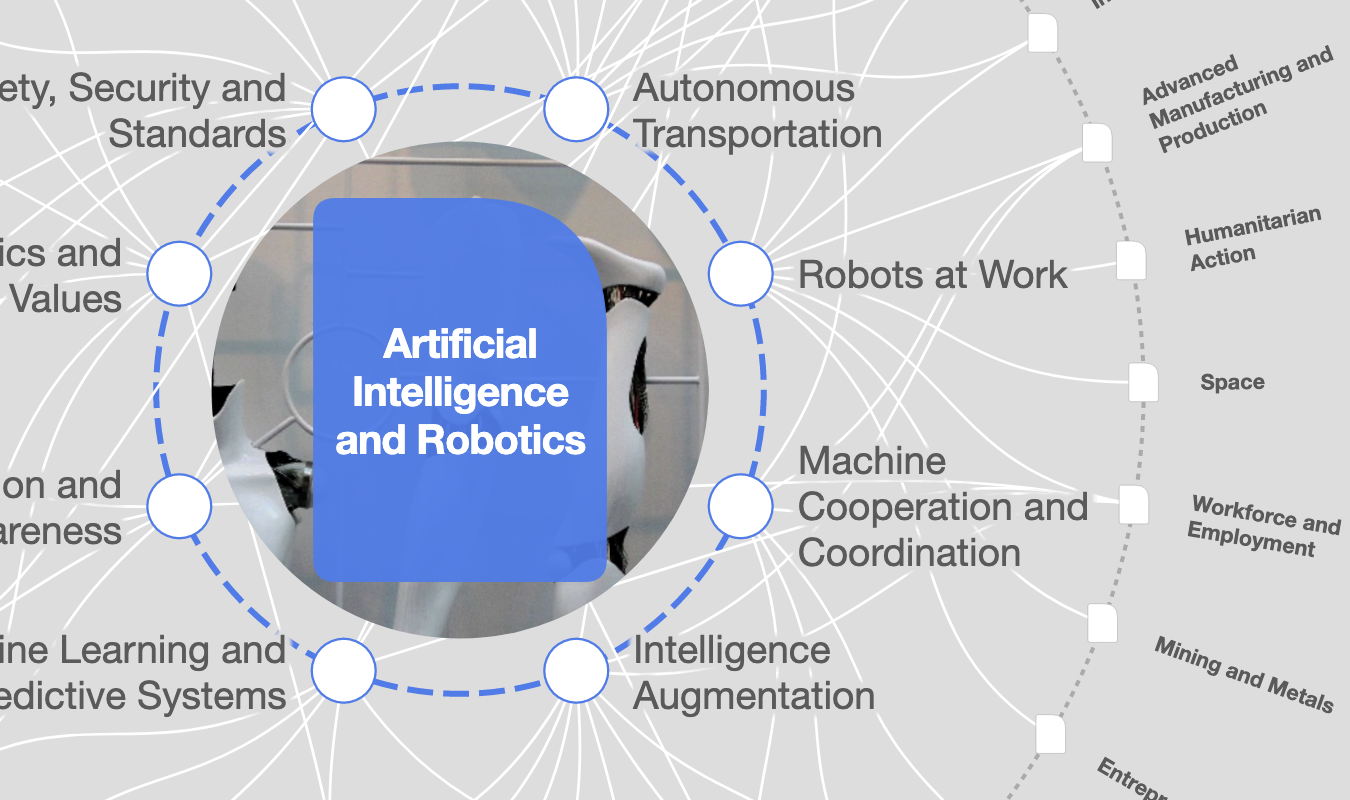

責任あるAI開発に、オープンソースが不可欠な理由

業界をあげてオープンソース開発を促進することで、創造性を高め、より安全なAIの開発をリードすることができます。 Image: Pixabay/Pexels

- 責任あるAIの開発・展開に対する統一的なアプローチが必要です。

- そのための規制を偏りなく策定するには、様々なテクノロジーの専門家が規制に関する議論に参加する必要があります。

- 規制を策定する際に多様な視点がなければ、責任あるAIの基礎になり得るオープンソースモデルが規制から漏れてしまうことになりかねません。

AI(人工知能)は、今日の世界を形成する最も強力なテクノロジーです。グローバルなサプライチェーンの最適化から創薬プロセスの加速化まで、AIは生活を向上させる大きな可能性を秘めています。しかし、安易に導入すれば、AIは偏見を蔓延させ、産業を根底から覆し、さらには人間の創造性やつながりを低下させ、私たちの日常生活に実害をもたらす可能性があります。

このように、期待とは大きく異なる結果が懸念される中、社会に利益をもたらすAIの活用方法について、熟慮を重ねた議論が必要です。当然、規制しようという声も上がるでしょう。

規制の核心にあるのは、責任あるAIの開発・展開に対する統一的なアプローチの必要性です。公正さを確保するために、AIモデルを多様なデータセットで訓練する必要があるのと同様に、規制が偏りなく策定されるためには、様々なテクノロジーの専門家が規制に関する議論に参加する必要があります。多様な視点がなければ、規制から責任あるAIの基礎としてのオープンソースモデルが漏れてしまうことになりかねません。

現在の規制に関する議論に欠けているもの

米国では、バイデン大統領の「AIの安全、安心、信頼できる開発と利用に関する大統領令」が、責任あるAIの重要な要素をいくつか取り上げています。これにはグラマリー社で優先的に取り組んでいる、信頼性の基準の策定や教育者がAIツールを安全に導入するための支援などが含まれています。

当社の立場が大統領令と異なる点の一つは、責任あるAI開発の核となるオープンソースモデルに対する信念です。

大統領令の第4.6項では、クローズドソースモデルを優先することが示唆されていますが、これはおそらく、大統領令の起草に当たって協議されたハイテク大手の視点を反映したものでしょう。バイデン政権は、オープンソースモデルをクローズドソースモデルとは異なる方法で評価し、オープンソースモデルに特化した勧告を策定する予定です。

私は、オープンソース開発に対するこのような制限は、ハイテク産業、ひいてはエンドユーザーを傷つけることになると考えています。欧州連合が提案した人工知能法についても同様の主張がなされています。

説明すると、クローズドソースのモデルは組織によって管理され、そのコードは使用や監査のために公開されることはありません。クローズドソースの大規模言語モデル(LLM)の例としては、グーグルのPaLM、OpenAIのGPTモデルファミリー、アンソロピックのClaudeなどがあります。第三者はアプリケーションプログラミングインタフェース(API)を通じていくつかのクローズドソースモデルを利用することができますが、コード自体を操作することはできません。

一方、テクノロジーイノベーションインスティテュートのFalcon LLMや、メタのLlama2のようなオープンソースのモデルは、イノベーションの名の下に、一般の人々が自由に使用し、変更することができます。今回の大統領令が暗に示しているように、悪者がオープンソースモデルのコードを意図的に変更し、セキュリティ上の問題につながることを懸念している人もいるかもしれません。

このような脆弱性は、すべてのソフトウェアが抱えているサイバーセキュリティのリスクと変わらないものであり、クローズドソースとオープンソースの両方の開発は何十年もの間受け入れられてきました。ベンチャーキャピタル、アンドリーセン・ホロウィッツのゼネラルパートナーであるマーティン・カサド氏が、バイデン大統領に宛てた書簡にあるように、オープンソースソフトウェアのLinuxは、米国政府全体のクラウドコンピューティングで広く使用されています。

実際、企業におけるオープンソースモデルの利用は増加傾向にあります。レッドハットの2022年版レポート「エンタープライズ向けオープンソースの現状」によると、ITリーダーの80%は企業向けオープンソースソフトウェアの利用を増やすことを期待しており、89%はオープンソースが代替のソフトウェアと同等かそれ以上に安全であると考えています。

さらに、業界でオープンソース開発を促進することで、次のようなメリットがあります。

- 創造性、イノベーション、競争の強化:オープンソースのAIモデルが利用可能になったことで、新しいアプリケーションの開発に必要な時間とリソースが大幅に削減され、より幅広い開発者がAIにアクセスできるようになったため、最大手のハイテク企業に限らず競争が促進されます。

- より安全なAI:モデルが公開されれば、開発者が新しいアプリケーションを構築するのに役立つだけでなく、製品をより安全にすることも可能になります。例えば、オープンソースのモデル、Seismographは、AIライティングアシスタントに機密性の高いコンテンツを扱わせるのに利用することができます。

- 透明性の向上:オープンソースモデルのデータセットやコードは、第三者による監査や検証が可能であり、品質や信頼性の確保に役立ちます。

最後のポイントは強調する価値があるでしょう。バイデン大統領令は、責任あるAIの最も重要な側面(安全性、セキュリティ、信頼性)の多くに焦点を当てていますが、重要な要素である透明性についてはあまり触れていません。

透明性がなければ、AIツールが安全、安心、信頼できるかどうかについて人々が意見を述べることは難しくなります。規制は、データ収集手法の共有から継続的なフィードバックループの導入まで、透明性を向上させる多くの方法を模索して制定されるべきですが、オープンソースモデルはその存在自体が透明性の道標となります。

オープンソースモデルだけが唯一の道ではありません。クローズドソースソフトウェアは、企業がAI製品を収益化する一般的な手法になっています。テック企業のCEOとして、私はクローズドソースモデルの必要性を十分に理解しています。私が恐れているのは、すべてのAI開発がクローズドソースになり、将来的にオープンソース開発が業界にもたらすイノベーション、責任モデル、透明性が低下することです。

私たちにできるもう一つのこと

テック企業のリーダーたちにとって、規制に従うことが責任あるAIを正しく取り扱っている証拠になることが最も理想的でしょう。だからこそ、私たちはグローバルな舞台で積極的に専門知識を共有し、規制がホリスティック(全体論的)に策定されるようにしなければなりません。

技術者がそれを実現するための3つの方法をご紹介します。

- オープンソースへの貢献:グラマリーのオープンソースモデルは、ジェンダーを考慮した文法エラー修正から繊細なテキストインタラクションまで、あらゆる分野をカバーしており、より責任あるAIライティングアシスタントの養成に貢献しています。オープンソースモデルを作成することで、幅広い開発者や業界が最高の製品を構築できるようサポートすることができるのです。

- 責任あるAIフレームワークを作成し、従う:当社には、TRUE フレームワークが存在します。このような意図的なフレームワークが業界全体で使用されるようになれば、最新のAI技術の多くのリスクは、規制が介入するずっと前に軽減されるでしょう。

- 敵対ではなく協力:社会をより良くするために尽力するAIリーダーとして、私たちの目標は、社会全体のためにAIをより良く利用できるようにすることです。エゴや競争よりも、責任あるAIを優先させるために仲間と協力しましょう。

潮の満ち引きがすべての船を持ち上げるように、より強力で責任あるAI業界を構築することは、AIの展開を成功させることにつながります。これには、AIをより安全で透明性の高いものにするオープンソーステクノロジーを共有する権利を守ることも含まれるのです。

このトピックに関する最新情報をお見逃しなく

無料アカウントを作成し、パーソナライズされたコンテンツコレクション(最新の出版物や分析が掲載)にアクセスしてください。

ライセンスと転載

世界経済フォーラムの記事は、Creative Commons Attribution-NonCommercial-NoDerivatives 4.0 International Public Licenseに基づき、利用規約に従って転載することができます。

この記事は著者の意見を反映したものであり、世界経済フォーラムの主張によるものではありません。

最新の情報をお届けします:

新興テクノロジー

関連トピック:

「フォーラム・ストーリー」ニュースレター ウィークリー

世界の課題を読み解くインサイトと分析を、毎週配信。

もっと知る 新興テクノロジーすべて見る

Naoko Tochibayashi

2025年11月14日