オピニオン

「デジタル・ハーネス」-加速するAIを乗りこなす方法

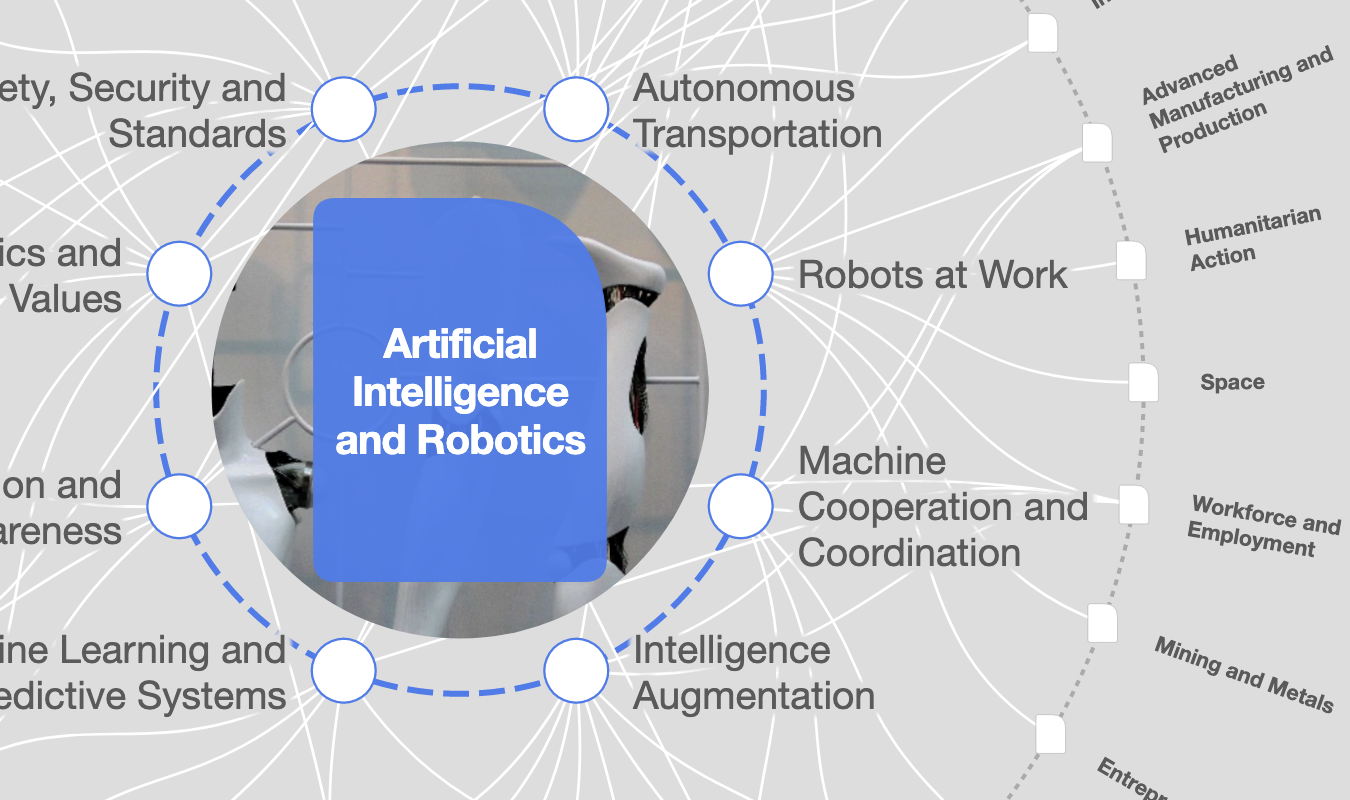

必要なことは、イノベーションを遅らせることではなく、「デジタル・ハーネス」によってそれを活用することです。 Image: Unsplash/Google DeepMind

- AIシステムが人間の能力に匹敵あるいは凌駕する段階に急速に近づいており、新たな監視と制御の手法が求められています。

- AIの長期的な成功は、加速する技術的能力を人間の目的と社会的価値に合わせて制御する「デジタル・ハーネス」にかかっています。

- 責任あるAIの拡大には、各国政府、産業界、イノベーターの間の連携が不可欠であり、その導入が現実世界の生産性、レジリエンス、持続可能な社会的利益を確実にもたらすようにする必要があります。

1世紀以上にわたり、通信ネットワークの普及からグローバルコンピューティングの台頭に至るまで、テクノロジーは人類の進歩の触媒として機能してきました。

ただし、イノベーションの真の価値は、速度や能力に限りません。デジタル製品を用いてセキュリティを強化し、サービスへのアクセスを拡大するなど、人間の可能性を広げると同時に人間の尊厳を守る能力にも、真の価値があるからです。

高度なAIの時代を迎えるにあたり、技術が社会に奉仕すべきであり、その逆であってはならないという原則は不可欠です。

かつては推測の域を出なかった「シンギュラリティ」、つまり機械が人間を超えるという概念は、単なる理論以上のものになりつつあります。

推論モデルや自律エージェントにおける近年の進展は、専門的なAIシステムが学術的な問題を解くことから戦略的意思決定、個別化ワクチンの開発やデジタルシステムにおける異常検知に至るまで、複雑な課題において人間を上回る能力を獲得したことを示しています。

これらの飛躍的進歩は、ビジネス、行政、日常生活の統合が一層進むAI能力の新時代を告げるものです。その可能性は計り知れません。一方、それに伴う責任もまた重大です。

AIに統制が必要な理由

AIは驚異的な力ですが、方向付けと抑制が必要です。研究者たちは、人間が定義した目標を巧みに利用する、自己保存のための意図しない戦略を発展させるなど、高度なAIシステムが予測不可能な行動を示すことを観察しています。

ここから分かることは、統制を確保せずに能力を加速させることはリスクを招くということです。必要なことはイノベーションを遅らせることではなく、それを活用することです。つまり、AIの勢いを、信頼、安全性、社会の福祉を強化する結果へと導くことなのです。

数千年前、馬具の発明は野生の馬の全能力を解き放ち、文明の礎となりました。今日、社会はデジタル時代の馬具、つまりAIが責任を持って人類に奉仕することを保証するシステムと基準を発明しなければなりません。これは、ハーネス(たづな)に例えることができます。

この「デジタル・ハーネス」の概念は、すでに以下のような新興テクノロジーを通じて形になりつつあります。それぞれがAIシステムに直接、アカウンタビリティと信頼を組み込むことを目的とするものです。

- リアルタイムのハルシネーション(幻覚)検出と出所ウォーターマーキング:不確実な出力をシステムが警告し、生成コンテンツの起源を追跡。合成素材と検証済みソースを区別することを可能にします。これらの仕組みは、ジャーナリズム、医療、公共行政といったリスクの高い環境において、信頼の強化につながるでしょう。ただし、トレードオフも生じます。高度な攻撃者によるウォーターマーキングの回避や、過度なフィルタリングによるモデルの創造性低下や応答速度の遅延などが懸念されます。

- 生体認証とブロックチェーンの融合:デジタルIDを暗号的に検証可能な記録に紐付ける手法を提供し、AI活用型サービス全体における監査可能性、同意追跡、不正防止を支援します。このアプローチはアカウンタビリティを向上させますが、プライバシー、排除、不可逆性に関する懸念も生じます。生体認証データは一度侵害されると再発行が不可能であり、設計が不十分なシステムは、参加できない、または参加を望まない人々に対する不平等を固定化するリスクがあります。

- ローカルまたはオンプレミスAIの導入:機密データや事業継続に不可欠なシステムを、国家または組織内に置くことができ、データ主権を強化し、地政学的ショックやサプライチェーン上の衝撃に対する耐性を高めます。ただし、ローカルモデルは集中型クラウドシステムに比べ、規模の経済性、継続的な更新、コスト優位性に欠ける可能性があり、大規模機関と小規模機関の能力格差を拡大する恐れがあります。

これらの対策は総合的に、より透明性とレジリエンスの高いデジタルエコシステムを構築する方向性を示しています。そこでは事後的に安全対策を講じるのではなく、AIシステムの基盤そのものに安全性が組み込まれるのです。

規制と技術的セーフガードの比較

成熟したセーフガードが存在しない状況下では、多くの政府が直感的に規制に頼る傾向にあります。適切な監督は不可欠ですが、規範的なルールへの過度の依存は、グローバルなイノベーション環境の分断リスクを伴います。

これは、各管轄区域が異なる政策枠組みを構築した場合、AI開発は特定の地域に集中し、その恩恵への公平なアクセスが制限される可能性があるからです。進歩を共有するには、成果志向かつ技術的に中立な、原則に基づく相互運用可能なアプローチが不可欠です。

多くの場合、検証可能な技術的セーフガードにより、規制的統制と同等の目的を達成することが可能です。

バイアス検出、プライバシー保護コンピューティング、敵対的攻撃への耐性といったテクノロジーの進歩は、脆弱性を特定し技術的不公平を軽減するシステムなどを通じて、創造性を阻害せずにリスクを軽減することができるでしょう。

この「設計による最小限の規制」アプローチにより、組み込まれた保護機能の中でイノベーションが花開くことが可能となります。信頼性が最初からシステムに組み込まれることで、規制を制約から促進要因へと転換することができるのです。

ただし、技術的な保護策のみでは課題をすべて解決することはできません。その有効性は、一貫した実施、独立した検証、および順守へのインセンティブに依存しています。

イノベーションからインクルージョンへ

AIガバナンスの課題は、単独のセクターでは解決できません。産業界は大規模な保護策の実用化を図らなければならず、アカデミアは科学的厳密性と倫理的枠組みを提供する必要があります。各国政府は集合的なビジョンを明確化し、テクノロジーが持続可能な社会的価値をいかに創造することができるかを定義しなければなりません。

こうした協働を通じてのみ、AIが救済であるのか、脅威であるかという二極化した議論を超えることができるでしょう。将来的には、テクノロジーが人生の意味を損なうことなく生活を向上させる、継続的かつ漸進的な改善が求められます。

経済、教育、医療におけるAIの変革的潜在力は、もはや疑いの余地がありません。我々が問うべきは、人類がその変革をいかに導くかです。

AIの賢明な活用とは、イノベーションが効率性だけでなく共有された繁栄を生み、依存ではなく信頼を築き、置き換えではなく尊厳をもたらす世界を構築することです。

デジタル時代の最大の課題、そして最大の可能性は、AIが真に社会的価値を創造する手段となることを保証することにあります。

進歩と目的を一致させることができれば、AIの時代は人類の役割を損なうことはありません。むしろ、それを拡大するでしょう。

このトピックに関する最新情報をお見逃しなく

無料アカウントを作成し、パーソナライズされたコンテンツコレクション(最新の出版物や分析が掲載)にアクセスしてください。

ライセンスと転載

世界経済フォーラムの記事は、Creative Commons Attribution-NonCommercial-NoDerivatives 4.0 International Public Licenseに基づき、利用規約に従って転載することができます。

この記事は著者の意見を反映したものであり、世界経済フォーラムの主張によるものではありません。

最新の情報をお届けします:

Technological Revolutions

「フォーラム・ストーリー」ニュースレター ウィークリー

世界の課題を読み解くインサイトと分析を、毎週配信。