ロボットは人間よりも有能なリーダーとなれるか?

政府のリーダーとしてのロボットは、意思決定を劇的に改善すると評論家は提案し始めています Image: 画像:Alex Knight

Zeger van der Wal

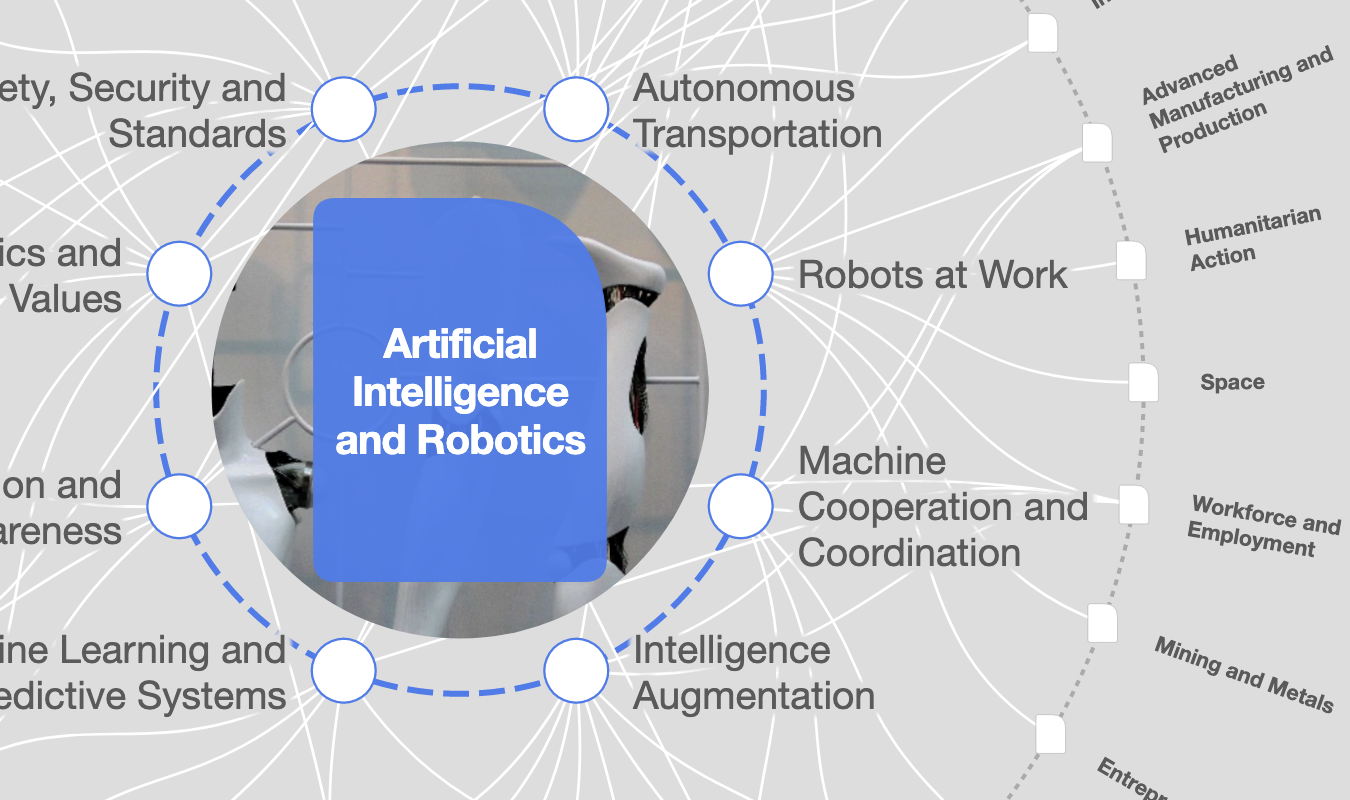

Associate Professor, Lee Kuan Yew School of Public Policy, National University of Singapore人工知能とロボットが様々なホワイトカラー業務を自動化することで、第四次産業革命は労働市場に大混乱を引き起こすと予測されていますが、この科学的な調査結果に該当しない職業があります。それは、最も批判され、詮索され、冷笑される職業の1つ、政府の指導者です。

しかし、インドや英国、ニュージーランド、日本など、多岐にわたる国の評論家たちは、ロボットが政府のリーダーになれば、意志決定は劇的に改善すると提案し始めています。これは本質的に間違いを起こす人間と比べて、ロボットは不合理的なことや不規則なことをほとんど起こさないという考えに由来しています。

米国ドナルド・トランプ大統領の予想外の選挙結果(とその後の言動)に対して専門家が繰り返し主張しているように、人の感情が政治を動かし、有権者は「許容すべき欠点」を支持する傾向にあるということは、現実に起こっていることが物語っています。それでも、複雑でリスクの高い意思決定を行うにあたり、「ロボット政府」は人間をよりもはるかに優れていないといえるのでしょうか。

投票にせよ任命にせよ、ロボットやサイボーグ、あるいはアルゴリズムによる統治はSF小説のように聞こえるかもしれませんが、ロボット政府の利点は明白です。ロボットは、多くの政府のリーダーたちを象徴するであろう、イデオロギー的な急進主義や視野の狭い考え方、あるいは個人主義的や自己陶酔的な傾向により生じる弊害とは無縁と言えます。つまり、ロボット政府は合理的で公正かつ均整がとれた科学的根拠に基づいた意思決定を行うことができるのかもしれません。

このため、優れたデータ分析能力と無限のエネルギーと「スタミナ」により(これらは、先の米国大統領選挙活動において最も議論された要因の1つです)、「ロボット政府は、いかなる人間のリーダーよりも迅速かつ行き届いた政治を行うことができるでしょう。

また、ロボット政府は汚職や非倫理的な言動に左右されることがほぼありません。こうした理由から、私たちは、失業手当の受給資格から多様な市民のニーズに対応するサービスの選定まで、複雑化した社会政策の問題に関する決断をAIに委ね始めています。

ロボットはまだ完全ではない

では、私たちはなぜ政治や行政の権限をロボット政府に与えないのでしょうか。その日はやがて訪れるのかもしれませんが、少なくとも3つの潜在的な欠点について真剣に目を向けなければなりません。

まず、うまく構成されたアルゴリズムであれば、AIが持つディープラーニングの大きな可能性を最大化させますが、不完全性や議論の余地が残る、あるいは倫理的に不明瞭または一部の公開されていない情報に対して、その有用性は大きく低下するという点です。

こうした状況は、まさに主要な政策決定や外交問題での意思決定が行われなければならない場面で起こります。それは、混沌として不完全な情報が蔓延した状況かもしれません。機械学習がこうした不確実性の中で想定しているように機能できるかどうかはまだ分かりません。「ロボット政府」とそうではない政府との協議を想像してみてください。そうした状況下で意思決定はどのように行われるのでしょうか。

2つ目は、ロボットやソフトウェアの可能性を広げていくためには、相当のインフラや教育能力が必要になるという点です。そうした能力が身近なものであっても、多くの社会では人々の能力は平等ではありません。今日のハイテクバブルは、既存の格差をさらに拡大させるかもしれません。プログラマーやオペレーターがそもそも偏見を持っている場合、AIの台頭も男女格差などの分野で不平等を長引かせることにもなりえます。

3つ目の欠点は、配慮が必要な意思決定にデータや機械をより広範に使用することが、データ漏えいやサイバー攻撃、計算誤差など、別のセキュリティリスクを生み出すということです。これにより、グローバルな安定性に対する危険性への対応が、せっかちで短気な人間の業務をロボットが取って代わることで得られる利点よりも優先されるかもしれません。人間の相互作用は破壊的な結果を生み出すこともありますが、必要により紛争を早期に解決することも可能です。これは、キューバのミサイル危機から昨今のトランプ‐キム会談まで多岐にわたる歴史的な事実が証明しているとおりです。(後者については、つい数週間前に核の脅威によって進展しました。)

機械と人間の協力関係

政府のリーダーが明らかに不完全であっても、ロボットに取って代わる選択肢は、当面は合理的とも最適ともいえないでしょう。依然として人間は、少なくとも民主主義においては、自動化がもたらしうる影響から人間社会を守る最も正当な主体となります。

しかし、昨今のフェイスブックのマーク・ザッカーバーグCEOの米上院での公聴会のような、目も当てられない失態を防ぐためには、政府のリーダーがデータやロボット工学の是非の検証、理解、管理してその役割を効果的に担っていくことが求められます。リーダーたちは、AIの倫理性や透明性、説明責任の規制や法律に関して、民間セクターに委ねるのではなく、より積極的に議論していくことも必要です。

AIと自動化は、究極的には人間の競争相手でも代役でもなく、政府のリーダーがより公正で包括的な意思決定を行うために効果的に活用し、時に従うことができるツールであるというシナリオがより現実的であり理想的です。権威主義体制はすでにロボットを悪用してその真逆の決定を行っている、と指摘する人もいるでしょう。市民に対する先例のない調査、個人情報の公開、社会的信用の低下を目的として、政府がAIの活用範囲を広げていることが、そうした重大な問題の提起につながっています。

必要以上に詮索され、リスクの高い公的な決定を要する別の分野、すなわちスポーツ界において楽観視される傾向にあるかもしれませんが、これには理由があります。技術に頼った審判には、「許容すべき欠点」や「独裁者」といった主張による抵抗が長年続きました。しかし、2018年のFIFAワールドカップでは、ホークアイの技術でサポートされた審判補助システム(VARシステム)の導入により、テクノロジーと権限を分かち合い審判を下す場面を目の当たりにしました。

ワールドカップ決勝の対フランス戦で下された疑わしい判定の後では、同意できないクロアチアのサポーターもいるかもしれません。それでも、ファンの多くの反応は広く前向きなものになっています。これはまさに、人間の審判がよりよい判断を下すために電子審判がサポートしていることが理由です。結果的に、試合そのもの、審判、そして主要な関係者全員がVARシステムの恩恵を受けました。政府への高い信頼と市民参加の向上により、私たちが同様の事実を世界の政治や政策でも目の当たりにすることが実現することが願われます。

このトピックに関する最新情報をお見逃しなく

無料アカウントを作成し、パーソナライズされたコンテンツコレクション(最新の出版物や分析が掲載)にアクセスしてください。

ライセンスと転載

世界経済フォーラムの記事は、Creative Commons Attribution-NonCommercial-NoDerivatives 4.0 International Public Licenseに基づき、利用規約に従って転載することができます。

この記事は著者の意見を反映したものであり、世界経済フォーラムの主張によるものではありません。

最新の情報をお届けします:

AIとロボティクス

関連トピック:

「フォーラム・ストーリー」ニュースレター ウィークリー

世界の課題を読み解くインサイトと分析を、毎週配信。